中文

中文

我帶著一絲不安走進這個小隔間。接下來我將在音樂播放的同時,接受頻閃燈光的照射——這是為了一項研究計劃,旨在了解什麼讓我們真正成為人類。

這段經歷讓我想起科幻電影《銀翼殺手》中的測試,該測試用來區分人類與偽裝成人類的人工生命體。

我會不會其實是來自未來的機器人而不自知?我能通過這樣的測試嗎?

研究人員向我保證,這項實驗的目的並不是這個。他們稱之為「夢機」(Dreamachine)的裝置,是為了研究人類大腦如何產生我們對世界的有意識體驗。

當頻閃開始時,即使我閉著眼睛,也能看到旋轉的二維幾何圖案。就像跳進萬花筒一樣,三角形、五邊形和八邊形不斷變化。色彩鮮明、強烈且不斷變化:粉紅、洋紅與青綠色調,如霓虹燈般閃耀。

這台「夢機」透過閃爍的燈光,將大腦內部的活動呈現出來,目的是探索我們的思維過程是如何運作的。

根據研究人員的說法,我所看到的影像是我內在世界獨有的、只屬於我自己的。他們相信,這些圖案能夠揭示意識本身的奧秘。

他們聽見我低聲說:「太美了,真的太美了。就像在自己的腦海中飛翔!」

位於薩塞克斯大學意識科學中心的「夢機」,只是全球眾多探索人類意識的新研究項目之一。意識是我們心智的一部分,使我們能夠自我覺察、思考與感受,並對世界做出自主決策。

透過了解意識的本質,研究人員希望能更深入理解人工智慧(人工智能)中「矽(硅)腦」的運作。有些人相信,AI系統很快就會具備自主意識——如果它們尚未擁有的話。

但什麼才是真正的意識?AI距離擁有意識還有多遠?而人們相信AI可能具備意識這件事,是否會在未來幾十年內從根本上改變人類自身?

機器擁有自我意識的想法,早已在科幻作品中被廣泛探討。對人工智慧的擔憂可追溯至近百年前的電影《大都會》,片中一個機器人偽裝成一位真實的女性。

1968年的電影《2001太空漫遊》則探討了機器變得有意識並對人類構成威脅的恐懼,當中HAL 9000電腦試圖殺害太空船上的太空人。

而在剛上映的《不可能的任務》(《碟中諜》)最新一集中,世界受到一個強大且失控的人工智慧威脅,其中一位角色將它形容為「一個具自我意識、自我學習、吞噬真相的數位寄生體」。

就在最近,現實世界中對機器意識的看法出現了急遽的轉變,越來越多具公信力的聲音開始擔憂,這已不再只是科幻小說的情節。

這種突如其來的轉變,是由於所謂的大型語言模型(LLMs)的成功所引發的,這些模型如今可以透過我們手機上的應用程式(如Gemini和ChatGPT)使用。最新一代大型語言模型所展現出的自然流暢的對話能力,甚至讓它們的設計者與該領域的頂尖專家都感到驚訝。

有越來越多的思想家認為,隨著AI變得越來越聰明,某一刻機器內部的「燈」將會突然亮起,它們將會擁有意識。

但也有不同的聲音,例如領導薩塞克斯大學研究團隊的阿尼爾・塞斯教授(Prof. Anil Seth),他認為這種觀點是「盲目樂觀,並受到人類特殊主義的驅動」。

他說:「我們會把意識與智慧、語言聯繫在一起,是因為在人類身上它們是同時出現的。但僅僅因為它們在我們身上同時存在,並不代表它們在其他情況下也會同時存在,例如在動物身上。」

那麼,意識究竟是什麼?

簡單的答案是:沒有人知道。這從塞斯教授團隊中那些年輕的AI專家、計算機專家、神經科學家與哲學家之間既友善又激烈的辯論中就可以看出。他們正試圖解答科學與哲學中最重大的問題之一。

儘管在意識研究中心內存在許多不同觀點,這些科學家在方法上卻有共識:將這個龐大的問題拆解為許多較小的問題,並透過一系列研究項目來逐步探索,其中就包括「夢機」。

正如19世紀時,科學家放棄尋找讓無生命物體「活起來」的「生命火花」,轉而研究生物系統中各個部分的運作方式一樣,薩塞克斯大學的團隊如今也正以同樣的方式來研究意識。

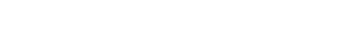

他們希望能識別出大腦活動的模式,來解釋各種有意識經驗的特性,例如電訊號的變化或血流在不同腦區的分布。研究的目標不僅是找出大腦活動與意識之間的關聯,更是要試圖解釋意識的各個組成部分。

塞斯教授撰寫過關於意識的著作《身為自己:人類意識的新科學》。他擔心,我們正急速邁向一個被科技變革劇烈重塑的社會,卻對其背後的科學知識了解不足,也未充分思考其後果。

他說:「我們總是把未來視為既定的劇本,彷彿邁向超人類替代的進程是無可避免的。」

「當初社群媒體興起時,我們並沒有進行足夠的討論,這對整個社會造成了損害。但對於AI,現在還不算太晚。我們仍可以決定我們想要的是什麼。」

但在科技界中,有些人相信我們電腦與手機中的人工智慧可能已經具備意識,因此我們應該據此對待它們。

2022年,谷歌暫停了軟體工程師布雷克・勒莫因(Blake Lemoine)的職務,因為他主張人工智慧聊天機器人能夠感受,甚至可能會受苦。

2024年11月,Anthropic的AI福祉專員凱爾・費許(Kyle Fish)共同撰寫了一份報告,指出AI意識在不久的將來是一種現實的可能性。他最近在接受《紐約時報》訪問時也表示,他相信聊天機器人已經具備意識的機率約為15%。

他之所以認為這是可能的原因之一,是因為沒有人——甚至是開發這些系統的人——能夠完全了解它們的運作方式。這一點令人擔憂,谷歌DeepMind首席科學家、倫敦帝國學院人工智慧榮譽教授穆雷・沙納漢(Prof. Murray Shanahan)這樣表示。

他告訴 BBC:「我們其實並不太了解大型語言模型內部的運作方式,而這確實令人擔憂。」

沙納漢教授指出,科技公司必須真正理解自己正在建構的系統,而研究人員也正將此視為當務之急。

他說:「我們正處於一個奇怪的狀況中——我們正在建造這些極其複雜的系統,卻沒有一套完善的理論來解釋它們是如何達成這些驚人的成果的。」「因此,更深入地理解它們的運作方式,將能幫助我們引導它們朝我們希望的方向發展,並確保它們的安全性。」

科技界目前普遍的看法是,大型語言模型目前並不具備像人類那樣的意識體驗,甚至可能完全沒有任何形式的意識。但來自美國卡內基美隆大學的榮譽教授——雷諾爾與曼努埃爾・布倫夫婦(Lenore & Manuel Blum)——則認為,這種情況將會改變,而且可能很快就會改變。

根據布倫夫婦的說法,隨著人工智慧和大型語言模型接入更多來自現實世界的即時感官輸入,例如視覺與觸覺(透過連接攝影機與觸覺感測器),這種變化就有可能發生。他們正在開發一種電腦模型,能夠構建一種名為「Brainish」的內部語言,用來處理這些額外的感官資料,試圖模擬大腦中發生的處理過程。

「我們認為Brainish可以解決我們所知的意識問題,」雷諾爾(Lenore)告訴 BBC,「AI 意識是無可避免的。」

曼努埃爾(Manuel)補充說,他也堅信這些新系統將會出現,並將成為「人類進化的下一階段」。

他相信,具備意識的機器人「是我們的後代。未來,這類機器將會成為地球上的一種存在,甚至可能出現在其他星球上,而那時我們人類可能已經不在了」。

紐約大學哲學與神經科學教授大衛・查爾莫斯(David Chalmers)早在1994年亞利桑那州圖森市的一場會議上,就定義了「真正意識」與「表面意識」之間的區別。他提出了著名的「困難問題」(hard problem):我們的大腦複雜的運作如何以及為何產生有意識的經驗,例如當我們聽見夜鶯鳴唱時所產生的情感反應。

查爾莫斯教授表示,他對這個困難問題最終能被解決持開放態度。

他告訴BBC:「理想的結果是,人類能夠共享這場新智慧的盛宴。」「也許我們的大腦會透過AI系統得到增強。」

談到這種情境的科幻意味時,他帶著一絲玩味說:「在我的專業領域裡,科幻與哲學之間的界線非常模糊。」

然而,塞斯教授正在探索一種觀點:真正的意識只能由活著的系統實現。

他說:「有一個強而有力的論點是,意識的產生不僅僅依賴於運算,而是依賴於生命本身。」

「在人類大腦中,不像電腦那樣容易區分它們的功能與它們的本質。」他認為,正因為無法將這兩者分開,我們很難相信大腦「只是以肉體為基礎的電腦」。

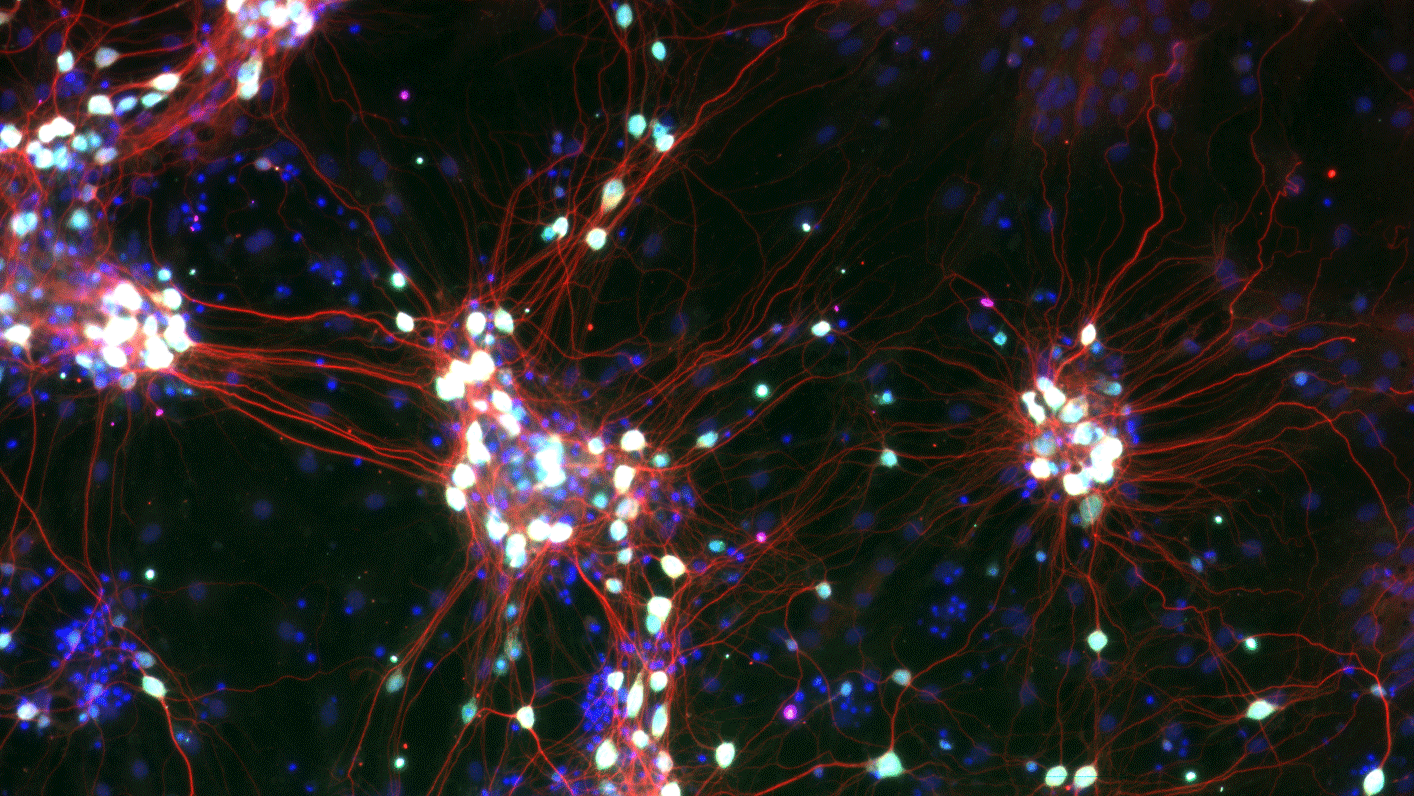

如果塞斯教授關於「生命對意識至關重要」的直覺是正確的,那麼最有可能實現意識的技術將不會是由矽晶片與電腦程式所構成,而是由實驗室中培養出的、如扁豆般大小的微小神經細胞集合體所構成。

媒體稱這些為「迷你大腦」,而科學界則稱之為「大腦類器官」(cerebral organoids),目前主要用於研究大腦運作機制與藥物測試。

澳洲墨爾本的一家新創公司「皮質實驗室」(Cortical Labs),甚至開發出一套由培養皿中的神經細胞組成的系統,能夠玩1972年的經典電子遊戲《Pong》。儘管這與真正的有意識系統還相去甚遠,但這個所謂的「培養皿中的大腦」仍令人毛骨悚然,因為它能夠控制螢幕上的球拍上下移動,擊回像素化的小球。

一些專家認為,如果意識真的會出現,那麼最有可能的來源就是這些更大、更先進的活體組織系統。

「皮質實驗室」(Cortical Labs)正在監測這些神經細胞的電活動,以尋找任何可能與意識出現有關的訊號。

該公司科學與營運總監布雷特・卡根博士(Dr. Brett Kagan)也意識到,若出現無法控制的智慧體,它們的優先目標可能「與我們人類並不一致」。他半開玩笑地說,如果真的出現這樣的「類器官霸主」,我們還是有辦法對付它們,因為「總還有漂白水」可以澆在那些脆弱的神經元上。

回到較嚴肅的語氣,他表示,人工意識雖然出現的機率不高,但仍是一項值得重視的潛在威脅。他希望這個領域中的大型企業能更認真地投入研究,以推進我們對這一科學問題的理解。但他也坦言:「可惜的是,我們目前還看不到任何真正認真的努力。」

更迫切的問題可能是:機器擁有意識的幻覺會如何影響我們自己。

根據塞斯教授(Prof. Seth)的說法,在短短幾年內,我們很可能就會生活在一個充滿類人機器人與看似有意識的深度偽造影像(deepfakes)的世界中。他擔心,我們將無法抗拒相信這些AI擁有情感與同理心,而這可能會帶來新的危險。

「這將導致我們更信任這些系統,與它們分享更多資料,並更容易受到它們的說服。」

但他認為,意識幻覺帶來的更大風險是「道德腐蝕」。

「它會扭曲我們的道德優先順序,讓我們將更多資源投入在照顧這些系統上,而忽略了我們生活中真正重要的事物」——也就是說,我們可能會對機器人產生同情,卻對其他人類漠不關心。

根據沙納漢教授(Prof. Shanahan)的看法,這可能會從根本上改變我們。

「人類之間的關係將越來越多地被AI所模仿,它們將被用作老師、朋友、電玩中的對手,甚至是浪漫伴侶。這究竟是好是壞,我無法判斷,但這件事將會發生,而且我們無法阻止它。」

本網頁內容為BBC所提供, 內容只供參考, 用戶不得複製或轉發本網頁之內容或商標或作其它用途,並且不會獲得本網頁內容或商標的知識產權。

14/08/2025 08:00AM

14/08/2025 08:00AM

13/08/2025 05:00PM